然而,在offline中,BCQ使用的VAE和生成擾動網路雖然解決了extrapolation error,但對於一些仍然處於行為策略分佈外(Out-of- Distributuin, OOD)的狀態-動作無法很好的擬合,本文闡述的BEAR

set:function setNodeValue(store: Store,state: TreeState,key: NodeKey,newValue: T | DefaultValue,): [DependencyMap, AtomV

*/class ConcreteStateA extends State {public handle1(): void {console

Linear(3,3)classRecover_Net2(nn

規定l 英國政府部門的翻譯n Prime Minister, First lord of the Treasury and Minister for the Civil Service 首相、首席財政大臣兼公務員事務部長n Deputy P

pp_summary)data ) )]let exec_return ~opts stk pre_state (block : Llair

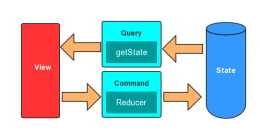

拿宇宙來說,如果我們有一個可以記錄宇宙所有狀態的相機,那麼按下一次快門所記錄的就是宇宙的一個 State,下一刻就是一個 Transition,宇宙的運轉就是一個無限狀態機,除非哪一刻宇宙毀滅了:一個 SPA 也可以用狀態機模型來描述:St

}2.React.memo用在函式元件的效能最佳化上,會對函式元件實現和PureComponent一樣的功能,對props和prevProps做一次shallowEqual淺比較

定義一個BYTE位元組,比如叫STATE,作為狀態碼先編碼sb1第0位m1執行正轉反饋第1位M1反轉執行反饋第2位定時器計時比較值分別是第3-7位sb2第8位然後 根據這個byte的值 (就是等於比較)輸出AO的不同數值 和DO比如

pyplotaspltnum_epochs=100total_series_length=50000truncated_backprop_length=15state_size=4num_classes=2echo_step=3batch_

size()==executors_and_keys->output_name_to_index

而在Newton’s method中,則是利用同時利用first-order和second-order derivative去達到這個目的:Newton‘s method做最最佳化就可以表達為如下的流程:而iLQR其實就可以理解為利用New

default:break

上兩條評論直接來源於字典解釋,我以自己的理解來闡述一下其中的邏輯:上兩個回答,字典定義中提到的Henry Harrison Suplee 就是在他關於汽輪機的設計製造中提出的這一概念,這其中有一定的必然性:瞭解機械製造或者建築的設計過程的人

由於很難求,所以將上式轉化成變分下界的形式,項透過SAC策略訓練時最大化動作的熵解決了,後面那項直接作為強化問題的pseudo-reward去最佳化policy,這樣agent會在訪問到更容易被區分的state時得到獎勵,同時更新discr

reduce_all(finished))def body(time, outputs_ta, state, inputs, finished, sequence_lengths):#呼叫step函式得到下一時刻的輸出、狀態、並得到下一時刻

Jiang Bian (Microsoft Research)ST-Norm: Spatial and Temporal Normalization for Multi-variate Time Series ForecastingAuth

}/*** 處理類似:* antd && 1*/主要取出邏輯運算子表示式的左右兩邊的變數,並使用 buildExpressionHandler 方法進行轉換ConditionalExpressionConditionalEx

5 uses = 2 category = radar_tech }|-#增加科技獎勵| set_demilitarized_zone || Sets a state as a demilitarized zone || any_owned