6um這裡需要分析光斑的大小,但是軟體裡面的Gaussian beam功能貌似並沒有考慮像差和衍射的問題,只考慮了透鏡本身的焦距,如此在做實際的設計的時候很難更加精確的分析光斑的大小所以就想到了軟體的另外一個功能POP進行分析,但是分析了之

pyplot as pltimport randomdef doss():return random

為每個人打造的一款具有驚人設計和材質的NORM 1智慧手錶,機身體現北歐價值觀和設計美感

torch中的梯度裁剪原始碼如下所示:defclip_grad_norm_(parameters:_tensor_or_tensors,max_norm:float,norm_type:float=2

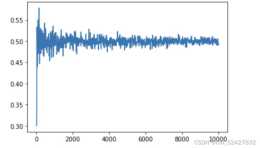

今天的話題從線性迴歸開始,在應對線性迴歸問題的時候,實質上就是訓練1個函式,這個等式可以透過我之前的文章最小二乘法來計算,即,但是由於最小二乘法需要計算矩陣的逆,所以有很多的限制,比如矩陣不可逆,又或者矩陣中有多重共線性的情況,會導致計算矩

Cauchy-Schwartz 不等式等號成立當且僅當 存在實數,使得證明:對任意的,都成立將左邊展開,就得到因此不等式得證

在這個例子中,我們先證明,接著證明,並且觀察此時的operator norm並沒有取到max

參考程式碼如下:% 四元數微分方程的4階龍格庫塔法% q0:4*1% gyro:陀螺儀資料% T:更新週期function[ q ]=Quaternion_RungeKutta4(q0,gyro,T)q0=Norm_Quaternion(q

y) / pi推導過程:(注意,下圖是Z軸向上)取樣法線貼圖,得到的是切空間法線tN,要透過切空間轉到世界空間,同樣是因為沒有mesh,所以切空間也要自己算:Z = normup = (0,1,0)X = -normalize(cross(

tensor([[1, 2], [3, 4]])b = torch

Motivation: formal derivation of estimates. To gain some insight as to what reguarity assertions could possibly be vali

Thenorm can be computed in terms of the Fourier transform:Fourier representation ofDefine theof a finite a belian groupt

cpu()delt_costh = torch

norm(a,1)#1範數printLA

3989422804014327print(st

實現根據上述推導結果,對Batch Norm關鍵的訓練、反向傳播、無偏估計預測部分,實現如下:訓練時的前向傳播:defbnForward_tr(self,x,gamma,beta,eps):mu=np

L1 和 L2 範數在機器學習上最主要的應用大概分下面兩類作為損失函式使用作為正則項使用也即所謂L1-regularization和L2-regularization我們可以擔當損失函式先來看個迴歸問題我們需要做的是,獲得一條線,讓資料點到

Batch Norm方法的作者,把上述問題歸因於internal covariate shift(ICS),認為:在DNN訓練過程中,每一層輸入資料的分佈,隨前層引數的變化而變,層間輸入分佈的變化,使訓練變得複雜,帶來了上述問題

假設此時v_i服從均值0、方差sigma^2的正態分佈,那麼密度函式以及對應的log-likelihood function是你會看到,雖然我們是從統計問題出發,得到一個最佳化形式的問題

因為我發現國內很多院校的線性代數課上根本不會cover用到matlab的內容,比如SVD分解、QR分解完全可以透過一行matlab程式碼完成,非要讓學生用手算,很多學生覺得麻煩索性就列個式子就直接抄答案了,或者就專注於算結果而不關注於他們的