結構風險最小化採用了最大後驗機率估計的思想來推測模型引數,不僅僅是依賴資料,還依靠模型引數的先驗假設

根據邊緣機率和聯合機率密度的定義,是對所有可能的的積分,即又根據條件獨立性有因此可以得到預測的分佈由於根據模型本身有,根據貝葉斯定律,有(其中和前面已有推導),則代入計算(比較複雜沒有推),有期望值仍然是MAP估計的值,但是現在可以得到方差

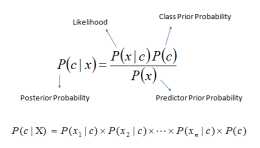

將剛剛的公示進行進一步泛化,我們就可以得到貝葉斯定律的公式: 為什麼貝葉斯定律很重要在公式中,右邊的條件機率部分也成為我們的似然引數(likelihood),也稱為(這句話我覺得翻譯了就很乖,所以不翻譯了) the likelihood o

所以,最大似然估計從資訊理論的角度來看, 是在最小化產生觀測資料的分佈 #FormatImgID_46# 和模型分佈 #FormatImgID_47# 之間的交叉熵, 即均方誤差損失與最大似然估計在實際生產中, 我們經常使用MSE(Mean

2.貝葉斯決策理論(Bayesian Decision Theory,BDT)1.基於最小錯誤率的Bayes決策a.條件錯誤率P(e|x)b.每個決策的錯誤率c.整個過程最小決策的錯誤率,需要正確分配的機率maxd.利用Bayes公式2.基

接著,我們試著把基於最大似然的邏輯迴歸改造成基於最大後驗估計的邏輯迴歸,但提前需要定義好引數的先驗

後驗指透過觀測方程計算,即p(x|v,y)狀態估計問題的分類:系統(線性L/非線性NL)噪聲(高斯G/非高斯NG)問題(批次式/遞迴式)兩種途徑解決批次LG系統的估計問題最大後驗估計MAP:使用最佳化理論,尋找給定資訊下(初始狀態、輸入、觀

總結一下,共軛分佈與期望型貝葉斯點估計的題分六步:第一步寫出樣本或充分統計量的密度第二步寫出後驗分佈與先驗分佈的關係第三步把第二步中得到的所有與無關的都當成是引數第四步在腦海中思考是否有密度長這樣,並寫出先驗分佈形式第五步寫出後驗分佈形式第

回顧上一張講的EM演算法步驟:E步驟:根據也就是Z的後驗機率求Q函式M步驟:極大化Q函式,對引數做最大化似然估計但是在實際過程中,對Z的後驗機率往往不是那麼容易求出來,也就是無法進行,從而導致EM演算法無法使用接下來這裡介紹一下EM演

但在多層神經⽹絡的情況下,似然分佈均值亦為,那麼後驗高斯分佈的指數項不再是引數的二次型,網路模型對於引數值的⾼度⾮線性意味著精確的貝葉斯⽅法不可⾏,而後驗機率分佈的對數⾮凸,正對應於誤差函式中的多個區域性極⼩值

現實中,模型的後驗機率不易得出,為此我們要對估計方法進行進一步修改,利用貝葉斯公式最大後驗估計的公式變化為,類似的,對於任意,都相等,所以上述最佳化問題等價為在上面的公式中出現了一個新的條件機率,稱其為模型的似然(likelihood)

利用歷史樣本估計的邊緣分佈,由此便可得到的後驗期望估計

使用貝葉斯方法處理不確定性,需要利用貝葉斯定理將先驗分佈更新至後驗分佈中,這無疑是最流行的方法之一

這裡採用貝葉斯方法建模epistemic不確定性,在給定資料下,取不同函式的可能性,即後驗分佈為:機器學習中的大部分模型,如神經網路、線性迴歸,都是和一組有限維引數相對應的,一組引數取值確定一個具體的模型,因此求f的後驗分佈等價於求引數w的

而依賴於經驗才能判明真假的,肯定不能僅靠分析成分間的邏輯和語義關係搞清楚,所以“後驗的”都是“綜合的”

其網路主要透過最佳化來實現網路的引數最佳化:在訓練過程中,KL項容易消失趨近於0,然後VAE網路的Decoder就會忽視Encoder產生的後驗分佈(此時已經坍塌成一個點了)而只從噪聲中取樣,從而使VAE網路失效

CAVI(Coordinate Ascent Variational Inference)—座標上升變分推斷The Mean-Field Variational Family:平均場理論最早應用於統計物理,假設變分後驗分佈是一種完全可分解的

定義裡的“共軛”體現在引數的先驗分佈與樣本的似然函式上

因為數學是先驗分析命題,而科學是後驗綜合命題

在瞭解了運動模型和觀測模型後,我們來看貝葉斯遞推濾波的預測和更新這兩個過程1) 預測過程:我們稱是時刻的目標狀態先驗機率密度(prior density)