實驗中,何愷明等人還用ImageNet預訓練了同樣的模型,再進行微調,成績沒有任何提升

模型是 ResNet-50圖 5:對批次大小的敏感度:BN(左)和 GN(右)在 ResNet-50 上的驗證誤差率,訓練是以 32、16、8、4 和 2 張影象/GPU 的吞吐量進行的圖 6:VGG-16 上 conv5 3 輸出(在歸一

其實這種基於電路網路的分析方法有助於理論理解,但是耦合矩陣綜合還是要參照Cameron 1999、2003年的論文提出的方法更為方便,在[1]中第8章作者對其進行了整理和補充

本書的重點是為學生提供對幾何的洞察力,幫助他們從一個統一的角度理解深度學習

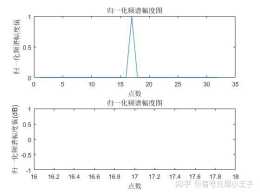

在找到問題之後,我將FFT的點數多設定了一些,程式碼如下:%% 這個Codes是用來構建矩形窗並進行FFT操作生成頻譜Sinc圖N=32

cn/aml第二十一講 圖神經網路之後1 經典圖神經網路的侷限性真實世界中的很多事物都能夠抽象成為網路結構,例如社交網路知識圖譜COVID圖圖神經網路常用來做圖節點的半監督分類任務,即給定圖上一些節點的標籤,根據節點之間的邊,預測未知標籤節

layer是“橫”著來的,對一個樣本,不同的神經元neuron間做歸一化

其中前面的是歸一化係數(波函式的平方是機率,所以需要歸一化)透過這個表達形式,可以瞭解到Slater行列式用不同波函式逐一描述不同電子,然後將其寫成行列式,就能很好的表達多電子(費米子)的波函數了

(建議閱讀最新版本)球諧函式預備知識球座標的拉普拉斯方程, 連帶勒讓德多項式當球座標中的拉普拉斯方程(球座標系中的拉普拉斯方程)分離變數後, 關於極角的函式為連帶勒讓德多項式, 方向角函式為. 我們定義球諧函式為1其中為整數,,.是歸一化系

一開始我用均值方差歸一化會導致我自己錄的純靜音資料很容易被誤喚醒,在流式處理中也出現了各種問題,後面關閉了方差歸一化後,就解決了

py(執行該檔案可以下載相應資料,根據格式整理後,存在本地備用)模型訓練入口\MoDeng\LSTM\AboutLSTM\Test\LSTM_Book

對數歸一化的目的是讓資料壓縮在0到1的範圍內,用公式表示如下:其中,x,y分別對應歸一化前後資料

而且如果你寫了百分之一千的話,那還有百分之一萬,一百萬,就沒有極限沒有一個最大的數去定義一定發生的事情

(1)線性鏈條件隨機場的原始引數化形式分數:歸一化機率:其中,歸一項為:t為定義在邊上的特徵函式,通常取值0或1,依賴於兩個相鄰結點的狀態,λ為其權重

0002)以及更大的batch size(2^9 ~ 2^12)且對於難調參的任務batch size可以設定得更大(2^14)些,更易獲得單調上升的學習曲線(3)Update Times線上學習的更新次數也是可以透過單輪更新取樣步數ste

硫酸鎂紙張問:平滑-基線校正-歸一化是紅外光譜資料處理的常見方法,處理會對光譜造成什麼樣的影響

Whiteout 基礎操作與UDN一樣,但將混合的幾張法線的B值相乘並附加到Z再歸一化(效能消耗更大了但質量更好)4

設為待估計的狀態變數,為針對該狀態量的兩次獨立測量值,那麼:這裡需要再次用到貝葉斯公式,將看成一個變數,那麼:假設是統計獨立的,那麼:現在我們將感測器模型代入上式,即可得到歸一化因子:那麼對於待估計狀態變數的兩次統計獨立的測量,我們可以透過

用分部積分法證明如下gamma function的更多性質由定義式出發不難證明伽馬函式在自變數取正整數時的值,例如進而利用基本遞推性質得到伽馬函式在自變數取零和負整數時是沒有定義的,這意味著將上式替換為得對於特別大的,比如氣體分子數,下面的

GAN 的搜尋空間可能非常巨大:探索所有包含各種損失函式、正則化和歸一化策略以及架構的組合超出了能力範圍,因此在這一項研究中,研究者在幾個資料集上分析了其中一些重要的組合