servlet包的Filter介面的三個方法init()、doFilter()、destroy(),空實現也行)(1)、啟動伺服器時載入過濾器的例項,並呼叫init()方法來初始化例項

Premiere CC 降噪外掛 Neat Video Pro 詳解運用Temporal filter radius : 時域濾波半徑(時間範圍內濾鏡的半徑值)Temporal filter threshold:時域濾波閾值(數值越小,噪點

filter(ee

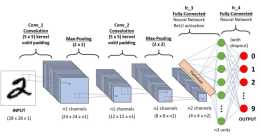

randn(10,1))再依據LeNet結構,寫出前向傳播的函式:deffeed_forward(self,x):#第一層卷積conv1=add_bias(conv(x,self

一定是Classic Chrome(其實這就是模擬大名鼎鼎的柯達kodachrome 64)一種更接近自然的顏色,用非玄學的話來說就顏色不那麼飽和,因為飽和了就像Velvia了是吧,然而色彩過渡又比較自然,讓數字播放器上的相片看上去更加雜誌

com/types-of-convolution-kernels-simplified-f040cb307c37直觀介紹各種迷人的CNN層一個簡短的介紹卷積使用“kernel”從輸入影象中提取某些“特徵”

只需要在標黃色處輸入函式=FILTER(C2:C35,B2:B35=F2)FILTER的第一個引數:結果所在的需要篩選的區域第二個引數:查詢的條件

com/p/443236752、《Generalized Intersection over Union: A Metric and A Loss for Bounding Box Regression》 CVPR2019在文章1中,要將I

}@keyframes moving { //兩個元素的移動0%{transform: translate(50px)}100%{transform: translate(-50px)}}實現融合效果的技術要點:contrast濾鏡應

= “”}2. cell按照上面的同樣的方式,獲取cell的property,如下:get_cells的使用方法如下:# 獲取頂層模組get_cells *# 獲取名稱中包含字元gen的模組get_cells *gen*# 獲取clk_ge

Cumulative % =VAR thisProductMargin = [Total Margin]VAR TotalMarginAllProducts =CALCULATE ( [Total Margin], ALL ( Produc

似乎瀏覽器就分為兩種),本質上都是使用filter的grayscale屬性,實現灰階效果,灰階是一種常用的圖片濾鏡

667,但是,這種情況下VSM裡面認為著色點的陰影測試結果直接為1,會帶來漏光的現象:左邊為使用VSM的效果,右邊為VSSM改進後的效果而VSSM中的想法也比較直接:既然當前這個filter不能滿足切比雪夫不等式,那就繼續將filter細分

用ReLu啟用後,CNN把activation map輸入第二個卷積層,在這裡,filter過濾的就是activation map中的特徵,這是一個從低層次特徵中提取高層次特徵的過程,雖然我們不知道計算機看到了什麼,但如果拿人類學習來類比,

padding 存在的意義在於為了不丟棄原圖資訊為了保持feature map 的大小與原圖一致為了讓更深層的layer的input依舊保持有足夠大的資訊量為了實現上述目的,且不做多餘的事情,padding出來的pixel的值都是0,不存在

+ n 1,因此add1 mul2沒有意義,不過如果你仔細看了習題2-3的答案你就會知道,一個更專業的答案是型別系統,因為加法的兩個引數都必須是數,給他一個函式就沒法加了,因此我們規定,如果一個表示式(或一個表示式的一部分)無論有沒有括號,

識別影象從訓練的結果中恢復訓練識別的引數,然後用於新的識別判斷開啟攝像頭,採集到圖片之後,進行人臉檢測,檢測出來之後,進行人臉識別,根據結果對應到人員名字,顯示在圖片中人臉的上面遺留問題weight 和 bias 的初始化好像有些問題,隨機

Dense(input,output,kernel)

4spp會以某種方式混個他們的計算並表現一個更好的效果,如下圖:螢幕空間抗鋸齒的通用方法是在螢幕區域使用一個取樣圖案(sampling pattern)取樣再對顏色計算加權和(即濾波或卷積):是單個畫素使用取樣點的數量,是取樣點權重(預設為