2D-to-3D之影象特徵到鳥瞰圖的轉換

關注微信公眾號:人工智慧前沿講習

對話方塊回覆“

book2

”獲取論文資料

該篇整體效能不算很強,在KITTI上的結果也排的很後。但是其中有一些思想(3D如何使用2D影象特徵)是值得一定程度借鑑的,不過與此同時,仔細研讀分析之後,作者目前的使用方式也的確會存在很大的問題。

我們重點來講作者如何利用2D的影象特徵來構建3D的鳥瞰圖特徵的。注意這裡作者沒有用到任何的lidar的資訊,3D上的鳥瞰圖只是一個構造出來的feature層,同時該feature會根據投影關係從2D的卷積feature中抽取得到。具體抽取的方式如下圖:

核心一點就是將卷積網路對影象卷積得到的feature,經過3D到2D的project+各種average pooling取到3D鳥瞰圖上,從而構成3D鳥瞰圖的feature map。這樣一來,我們就可以在該feature map上自由地迴歸各種具有3D屬性的物件了。

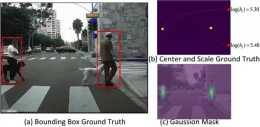

這種投影取卷積feature的方式值得借鑑,不過深思一下,目前的這種方式的確還存在很多問題。其實有些問題就暴露在論文中的一些圖片中了。比如我們看確定position的訓練過程圖:

大家可以看到明顯的散射狀,並且一直學到最後散射狀的情況還是明視訊記憶體在的。這是因為相機光心穿過每輛車身後的區域都會投影落在2D的車輛上,從而使得他們捕捉到非常相似的特徵。然而,網路給到的監督卻需要強行學習到這些微小的區別,並只給第一個接觸到的點最強的輸出。這樣網路的學習壓力會非常的大,所以其實建議能夠引入一些位置的編碼或者採用一些trick減輕網路的壓力(如採用輻射狀的迴歸,每條輻射線只回歸最近的最大響應值)。

另外還有一個比較普遍的問題,也是現有大部分演算法基本上都暫時不考慮的一個問題,就是相機外參的變化。車輛在行駛過程中會產生起伏,從而導致相機的外參會不斷變化,使得路面是水平的面這個假設很難成立。所以如下圖:

其中10m,20m這些畫的線其實理應會不斷變化的,應該是時近時遠的。可能這個對迴歸較近處的車不是特別敏感,但是等車輛距離超過100m,就會有很大問題。另外,超過100m之外地面本身的起伏也會大大影響對車距的判斷。所以,從2D image估計3D屬性的任務任重而道遠,還有非常非常多強的挑戰等著我們。

@知乎:李翔

版權宣告

本文版權歸《李翔》,轉載請自行聯絡。

上一篇:學設計哪個方面最容易掙錢?

下一篇:《安琪》 :唐家有子初長成(一)